图神经网络最新研究进展与应用:「扩展性」、「鲁棒性」、「表达能力」

唐今里

第三个倒霉蛋

关注【GEAR图学习】公众号,每日获取最新图学习研究资讯!

原文链接:

图神经网络最新研究进展与应用:「扩展性」、「鲁棒性」、「表达能力」mp.weixin.qq.com/s?__biz=Mzg5MjY0NTQ1MQ==&mid=2247484431&idx=1&sn=b3f7caa7bae00781983a1143b2e7b30e&chksm=c03bbd2bf74c343dc2a4d6f9aaa4dc88bd6e15aa15a35bd27014f625d897339b1fa20509496b&token=1539325454&lang=zh_CN#rd

1 图神经网络最新进展

图神经网络(Graph Neural networks, GNNs)由于它们对复杂数据结构建模的有效性,可扩展性强以及方法的可用性高,被广泛用于各种应用和领域。在本文中,我们简要回顾了近年来关于图神经该网络最新的研究进展和应用。

1.1图神经网络扩展性

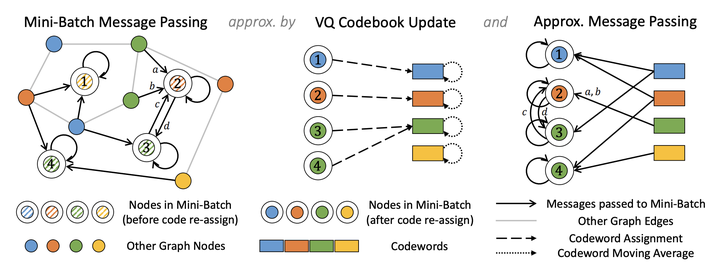

大多数最先进的图神经网络通常都涉及到通过相邻或相邻区域之间的消息传递实现的图卷积(消息传递message passing)。将GNN扩展到大型图结构数据通常需要使用采样技术,从而只考虑消息的一小部分进行传播。然而,这些采样技术限制了GNN在每一层中去利用多跳(many-hops-away)或全局上下文(global context)信息。这些都很难应用于每层利用多跳或全局上下文的gnn。此外,采样还使GNN在不同任务和数据集的性能变得不稳定,并且也无助于加速模型推理过程。最近Dinget al. (2021)提出了一个框架,VQ-GNN,通过使用向量量化提高基于卷积的GNN扩展性。

与采样技术相比,VQ-GNN保留传递给一个小批节点的所有消息。这一过程是通过在每个 GNN 层中使用矢量量化来学习和更新全局节点表示的少量量化参考矢量来完成的。这个新框架有助于在不影响性能的同时避免“邻居爆炸”问题。VQ-GNN 在大图节点分类和链接预测基准上展示了可扩展性高和有竞争力的性能。

VQ-GNN论文与代码: https://paperswithcode.com/paper/vq-gnn-a-universal-framework-to-scale-up?from=n19

VQ-GNN结果: https://paperswithcode.com/paper/vq-gnn-a-universal-framework-to-scale-up?from=n19#results

1.2图神经网络鲁棒性

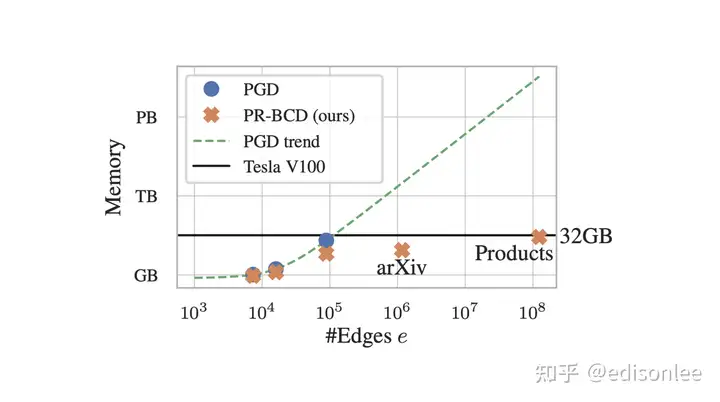

正如上一节所述,图神经网络在可扩展性方面仍有改进的空间。不仅如此,GNNs还缺乏对于对抗攻击的鲁棒性,而这一研究目前仍然也是限制于图结构数据的规模而有待进一步扩展。目前,大多数相关工作都侧重于研究 GNN 对小图的对抗性攻击的脆弱性。在本文中,Geisler et al. (2021) 研究了大规模图数据中提高 GNN 鲁棒性的问题。关于GNNs在大图数据中的对抗鲁棒性研究,之前公众号也介绍过,详见 TKDE'21 | 面向大规模图数据的对抗攻击。

随着 GNN 部署在实际应用中,研究它们在大规模数据场景下的鲁棒性变得十分重要。为了应对这一挑战,这项工作引入了实用且内存高效的攻击,即使参数数量与节点数量成二次方关系。此外,这个工作还提出了使用鲁棒聚合函数 Soft Median 的可扩展防御,该函数在所有规模数据集上都证明是鲁棒和有效的。防御可以将攻击的成功率从 90% 左右降低到 1%。该工作提出的攻击和防御首次在多达 1.11 亿个节点的图数据集上使用标准 GNN 进行评估。这是评估和改进 GNN 系统在实际应用中的稳健性迈出的一步。

论文与代码: https://paperswithcode.com/paper/robustness-of-graph-neural-networks-at-scale?from=n19

1.3 嵌套(Nested)图神经网络

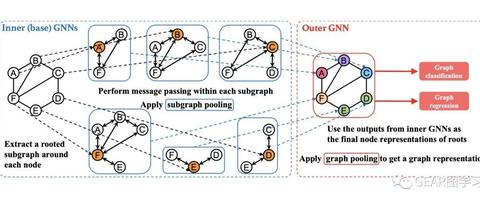

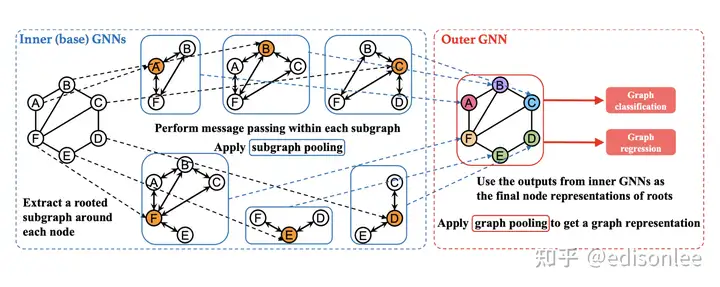

GNN 通过迭代地将相邻节点特征聚合到中心节点来获得节点表示。节点表示编码了围绕中心节点的一棵有根子树,然后将其合并为单个全图表示。这些有根子树的表达能力对于表示非树图结构是有限的。为了解决这个问题,Zhang and Li (2021) 提出了一个新框架,即嵌套图神经网络 (NGNNs),用于解决上述这个问题,并表示一个带有根子图而不是子树的图。

这种方法通过使每个节点表示编码围绕它的子图而不是子树来提高表达能力和表示。如上图所示,NGNN 在每个节点周围提取一个局部子图,然后将带有池化层的基础 GNN 应用于每个有根子图以学习子图表示。子图表示用作根节点的最终表示。然后将最终节点表示应用于图池化层以获得全图表示。NGNN 可以通过即插即用的方式与各种目前提出的 GNN 相结合,并在多个基准数据集上取得有竞争力的结果。

论文与代码: https://paperswithcode.com/paper/nested-graph-neural-networks?from=n19

结果:https://paperswithcode.com/paper/nested-graph-neural-networks?from=n19#results

2 图神经网络近期应用

以下是一些使用GNN的其他最新进展和应用:

- GNNs 用于改进命题可满足性求解 - Wang et al. (2021)[1]

- GNNs 用于不平衡节点分类 - Wang et al. (2021)[2]

- GNNs 用于用于交通场景规划 - Peregrino et al. (2021)[3]

- GNNs 用于协同过滤(推荐) - Chen et al. (2020)[4]

- GNNs 用于蛋白质推理预测 - Fout et al. (2017)[5]

- GNNs 用于交通预测 - Zhang et al. (2021)[6]

- GNNs 用于图元胞自动机(graph cellular automata)学习 - Grattarola et al. (2021)[7]

- GNNs 用于COVID-19预测 - Xue et al. (2021)[8]

- GNNs 用于多模态神经成像融合学习 - Shi et al. (2021)[9]

- GNNs 用于源代码漏洞检测 - Nguyen et al. (2021)[10]

3 Papers with Code 热门趋势

3.1 Top-10热门论文

- ResNet strikes back![11]

- Non-deep Networks[12]

- 8-bit Optimizers via Block-wise Quantization[13]

- MobileViT[14]

- CIPS-3D: A style-based, 3D-aware image generator[15]

- FlexMatch: Boosting Semi-Supervised Learning with Curriculum Pseudo Labeling[16]

- ADOP: Approximate Differentiable One-Pixel Point Rendering[17]

- Parameter Prediction for Unseen Deep Architectures[18]

- SaLinA: Sequential Learning of Agents[19]

- A few more examples may be worth billions of parameters[20]

参考资料

[1] Wang et al. (2021): https://paperswithcode.com/paper/improving-sat-solving-with-graph-neural?from=n19

[2] Wang et al. (2021): https://paperswithcode.com/paper/distance-wise-prototypical-graph-neural?from=n19

[3] Peregrino et al. (2021): https://paperswithcode.com/paper/transportation-scenario-planning-with-graph?from=n19

[4] Chen et al. (2020): https://paperswithcode.com/paper/revisiting-graph-based-collaborative?from=n19

[5] Fout et al. (2017): https://paperswithcode.com/paper/protein-interface-prediction-using-graph?from=n19

[6] Zhang et al. (2021): https://paperswithcode.com/paper/gacan-graph-attention-convolution-attention?from=n19

[7] Grattarola et al. (2021): https://paperswithcode.com/paper/learning-graph-cellular-automata?from=n19

[8] Xue et al. (2021): https://paperswithcode.com/paper/multiwave-covid-19-prediction-via-social?from=n19

[9] Shi et al. (2021): https://paperswithcode.com/paper/a-heterogeneous-graph-based-framework-for?from=n19

[10] Nguyen et al. (2021): https://paperswithcode.com/paper/regvd-revisiting-graph-neural-networks-for-1?from=n19

[11] ResNet strikes back!: https://paperswithcode.com/paper/resnet-strikes-back-an-improved-training?from=n19

[12] Non-deep Networks: https://paperswithcode.com/paper/non-deep-networks-1?from=n19

[13] 8-bit Optimizers via Block-wise Quantization: https://paperswithcode.com/paper/8-bit-optimizers-via-block-wise-quantization?from=n19

[14] MobileViT: https://paperswithcode.com/paper/mobilevit-light-weight-general-purpose-and?from=n19

[15] CIPS-3D: A style-based, 3D-aware image generator: https://paperswithcode.com/paper/cips-3d-a-3d-aware-generator-of-gans-based-on?from=n19

[16] FlexMatch: Boosting Semi-Supervised Learning with Curriculum Pseudo Labeling: https://paperswithcode.com/paper/flexmatch-boosting-semi-supervised-learning?from=n19

[17] ADOP: Approximate Differentiable One-Pixel Point Rendering: https://paperswithcode.com/paper/adop-approximate-differentiable-one-pixel?from=n19

[18] Parameter Prediction for Unseen Deep Architectures: https://paperswithcode.com/paper/parameter-prediction-for-unseen-deep?from=n19

[19] SaLinA: Sequential Learning of Agents: https://paperswithcode.com/paper/salina-sequential-learning-of-agents?from=n19

[20] A few more examples may be worth billions of parameters : https://paperswithcode.com/pape